層の種類

DeepLearningは複数の層をつなげることで一つのネットワークを構築します。その際に層にはいくつもの種類があり、目的に応じてどの層を選ぶかが異なってきます。

例えば画像処理でよく用いられるConvolution層、Convolution層の次の層に挟まれることの多いPooling層があります。

2017.9.3

-

332Views

-

0Watch

-

10Knows

|

|

層の種類の新規投稿

Convolutionの誤差逆伝播

畳み込み層(Convolution層)の誤差逆伝播の計算についてのみまとめているページです.Convolutionの誤差逆伝播では、後続層からの入力と180度回転したConvolution層のパラメータ、順伝播の入力値を使って計算します.

PV 378

Fav 0

2019.01.28

Perturbation層

Perturbation層(perturbationは摂動)は入力されたチャンネルにランダムに生成した固定のノイズを足し合わせ非線形変換したものを重みで足し合わせて出力する層.実際にはConvolution層のような3x3の畳み込みは行わず、画素に注目しており言わば1x1の畳み込みを行っている.

Convolution層で構成されるCNNをPerturbation層で置き換えたPNNを用いてもこれまでCNNで達成されていた性能が達成できる.

ここではPerturbation層について簡単に紹介する.

PV 215

Fav 0

2018.07.05

Deconvolution はUnpoolingやUpsamplingとは違いますか?

PV 138

Fav 0

2017.09.26

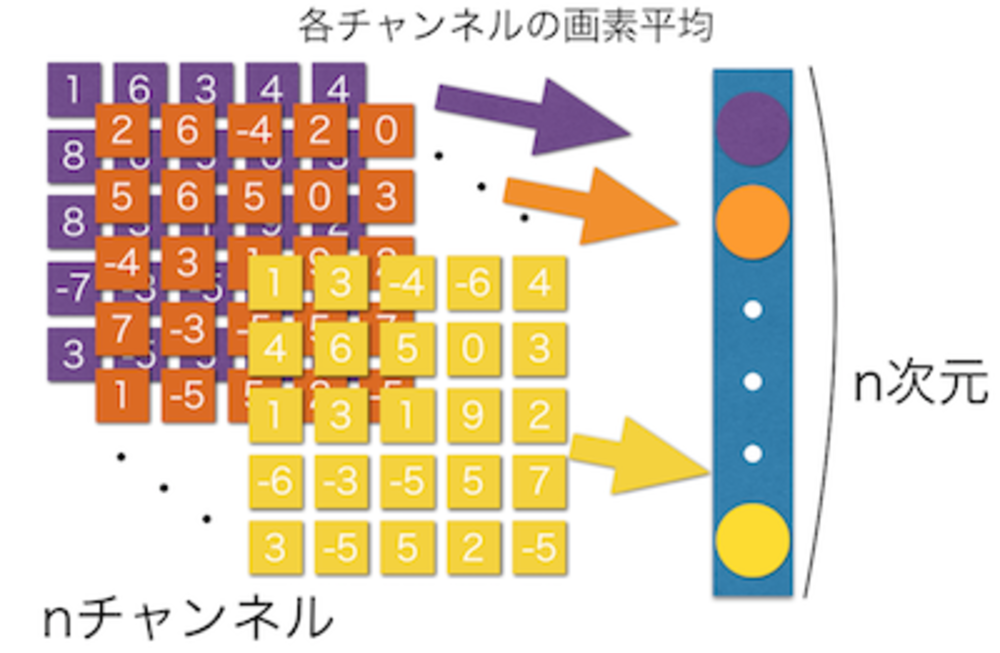

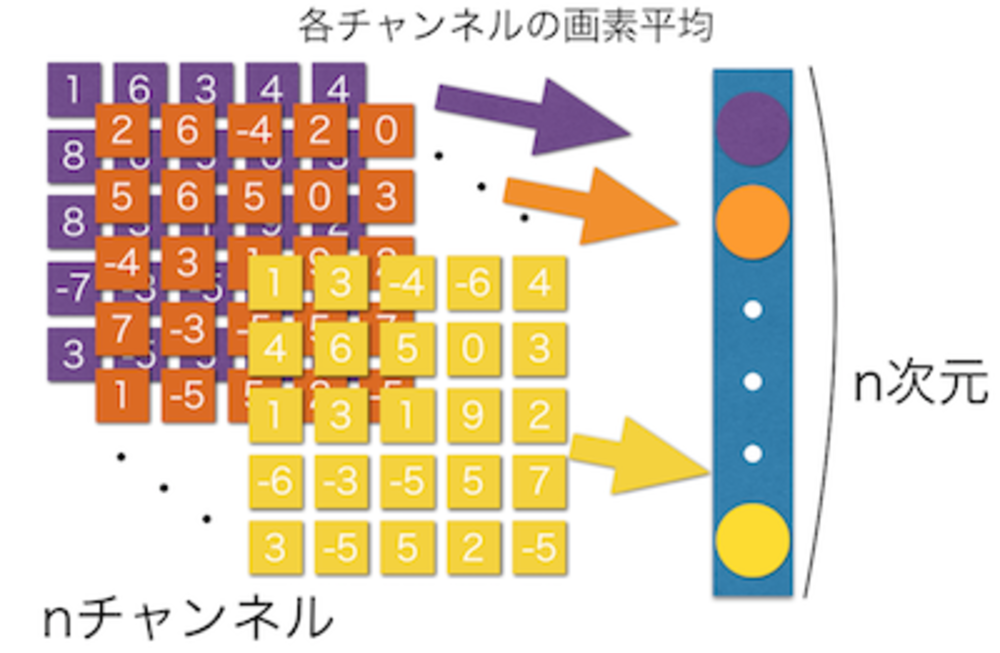

Global Average Pooling層

Global Average Pooling層によって最後の層において直接平均してクラスを作り出す。

PV 880

Fav 0

2017.09.18

Batch Normalization層

Batch Normalization層は近年提案されるどのネットワークにも大体使用される学習を安定させ高速化させる技術. ミニバッチごとの平均と分散を計算して正規化し、スケールとシフト補正をする.

PV 446

Fav 0

2017.09.13

Deconvolution層

厳密な数学の定義とはDeconvolutionの意味は違っており、transposed deconvolutional layerと呼ぶ方がよいとされる。

PV 289

Fav 0

2017.09.13

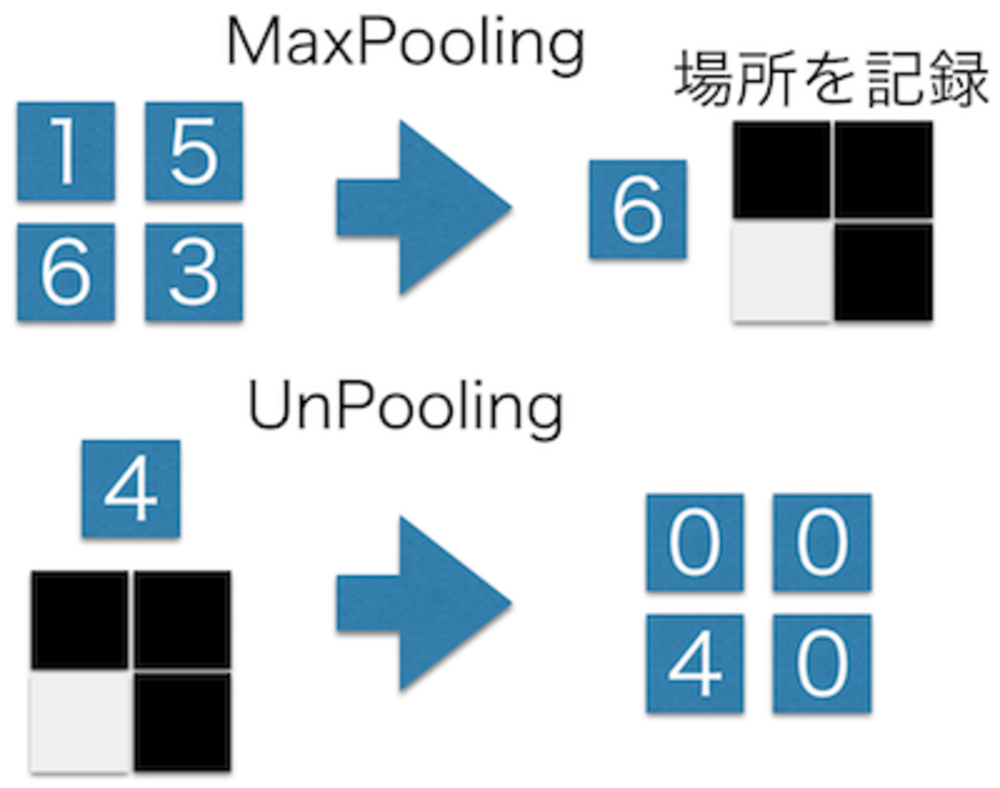

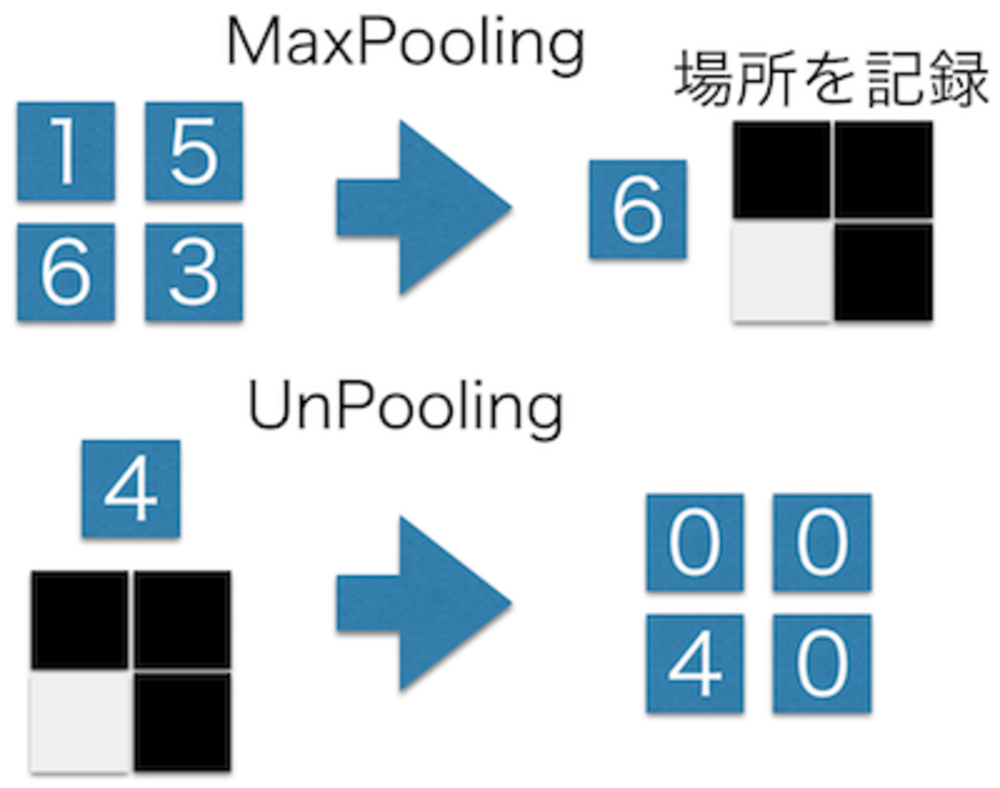

UnPooling層

Convolutional AutoEncoder(CAE)などで用いられるMaxPoolingの反対の動き(画素を拡大する)をする層

PV 462

Fav 0

2017.09.13

SumPooling層

入力される値全てを足したものを出力するニューラルネットワークの層の一つ.

AveragePooling層とほぼ同一の役割

PV 202

Fav 0

2017.09.13

AveratePooling層

元となる入力の平均を求めるニューラルネットワークの層の種類の一つ.他にMaxPoolingなどがあり、情報の圧縮が大きな役割.

PV 203

Fav 0

2017.09.13

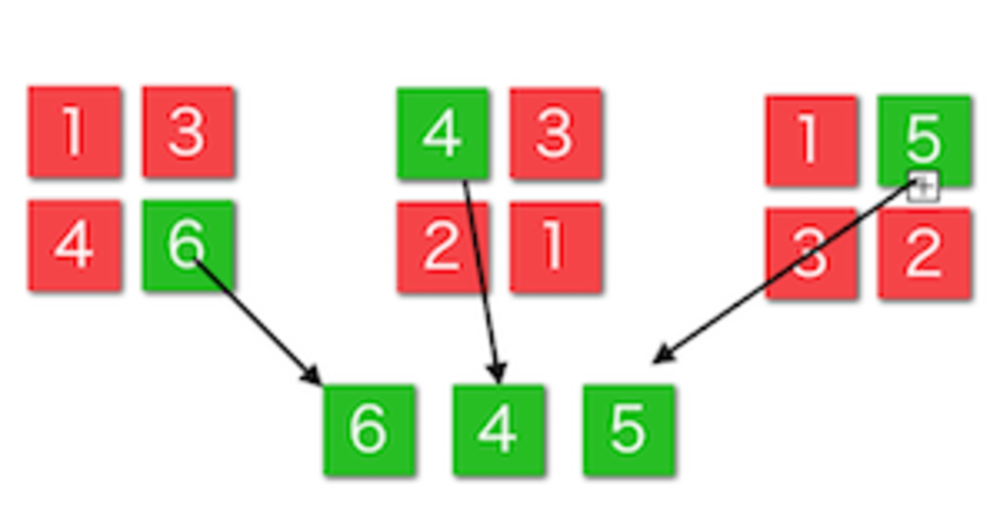

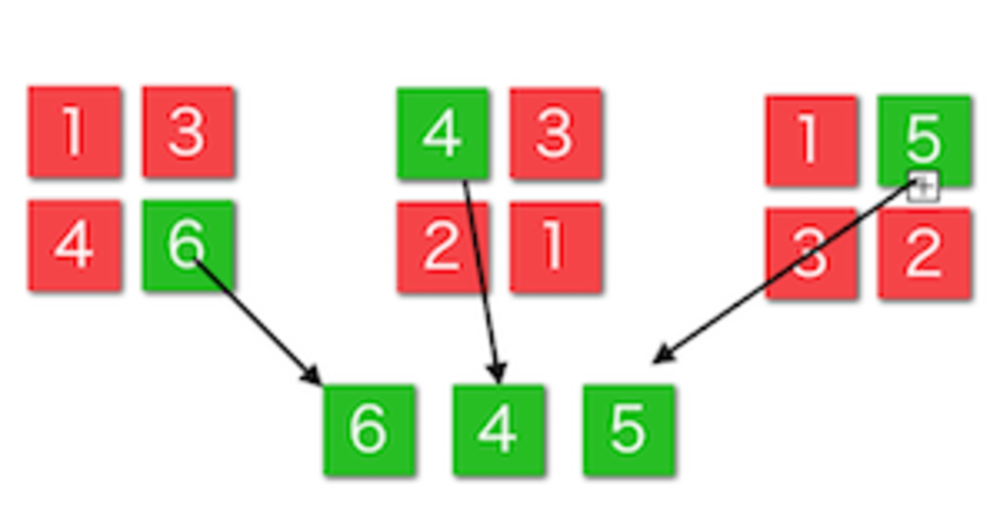

MaxPooling層

Poolingは入力のデータを削減することや特徴を位置のずれに強くするために使用する。

MaxPooling層は候補のうちから最大を一つ選ぶ。

PV 249

Fav 0

2017.09.13

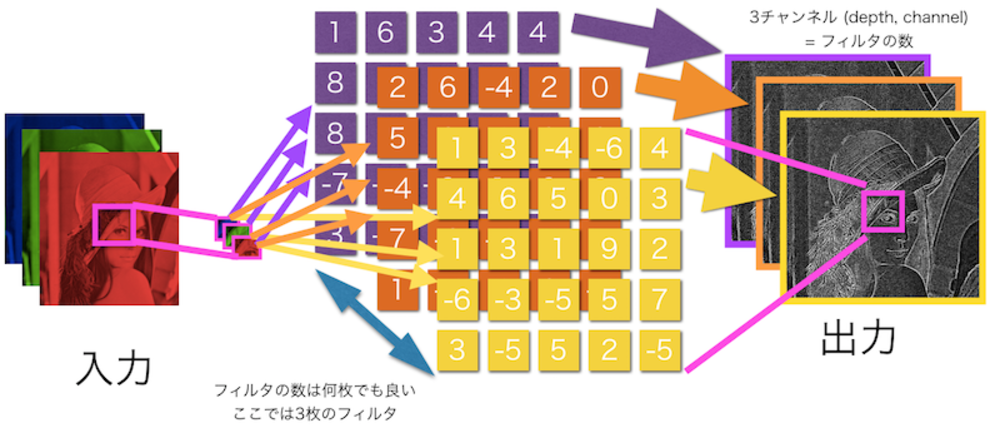

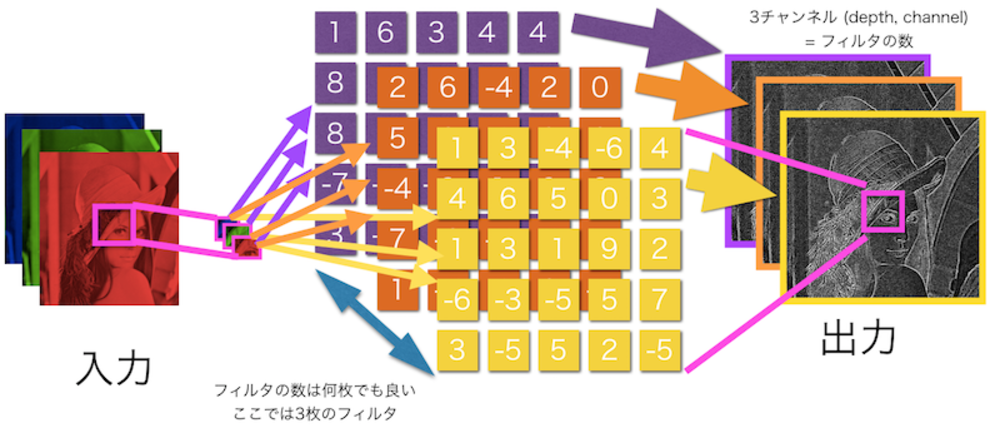

Convolution層

近年の画像入力のニューラルネットワークで活躍しているConvolution層(Conv層, 畳み込み層).

計算はかなりシンプルで、画像の各部分に対して行列を掛け合わせていき、その結果を新しい画像に詰め込んでいく処理。

世の中で解説も多いので簡単な解説に留める。

PV 216

Fav 0

2017.09.13

層の種類人気知識・質問

Global Average Pooling層

Global Average Pooling層によって最後の層において直接平均してクラスを作り出す。

PV 880

Fav 0

2017.09.18

UnPooling層

Convolutional AutoEncoder(CAE)などで用いられるMaxPoolingの反対の動き(画素を拡大する)をする層

PV 462

Fav 0

2017.09.13

Batch Normalization層

Batch Normalization層は近年提案されるどのネットワークにも大体使用される学習を安定させ高速化させる技術. ミニバッチごとの平均と分散を計算して正規化し、スケールとシフト補正をする.

PV 446

Fav 0

2017.09.13

Convolutionの誤差逆伝播

畳み込み層(Convolution層)の誤差逆伝播の計算についてのみまとめているページです.Convolutionの誤差逆伝播では、後続層からの入力と180度回転したConvolution層のパラメータ、順伝播の入力値を使って計算します.

PV 378

Fav 0

2019.01.28

Deconvolution層

厳密な数学の定義とはDeconvolutionの意味は違っており、transposed deconvolutional layerと呼ぶ方がよいとされる。

PV 289

Fav 0

2017.09.13

MaxPooling層

Poolingは入力のデータを削減することや特徴を位置のずれに強くするために使用する。

MaxPooling層は候補のうちから最大を一つ選ぶ。

PV 249

Fav 0

2017.09.13

Convolution層

近年の画像入力のニューラルネットワークで活躍しているConvolution層(Conv層, 畳み込み層).

計算はかなりシンプルで、画像の各部分に対して行列を掛け合わせていき、その結果を新しい画像に詰め込んでいく処理。

世の中で解説も多いので簡単な解説に留める。

PV 216

Fav 0

2017.09.13

Perturbation層

Perturbation層(perturbationは摂動)は入力されたチャンネルにランダムに生成した固定のノイズを足し合わせ非線形変換したものを重みで足し合わせて出力する層.実際にはConvolution層のような3x3の畳み込みは行わず、画素に注目しており言わば1x1の畳み込みを行っている.

Convolution層で構成されるCNNをPerturbation層で置き換えたPNNを用いてもこれまでCNNで達成されていた性能が達成できる.

ここではPerturbation層について簡単に紹介する.

PV 215

Fav 0

2018.07.05

AveratePooling層

元となる入力の平均を求めるニューラルネットワークの層の種類の一つ.他にMaxPoolingなどがあり、情報の圧縮が大きな役割.

PV 203

Fav 0

2017.09.13

SumPooling層

入力される値全てを足したものを出力するニューラルネットワークの層の一つ.

AveragePooling層とほぼ同一の役割

PV 202

Fav 0

2017.09.13

Deconvolution はUnpoolingやUpsamplingとは違いますか?

PV 138

Fav 0

2017.09.26